ニュース

「GMO GPUクラウド」Slurmサービス専用プランにて「NVIDIA HGX B300」を提供開始

~最新NVIDIA Blackwell Ultra GPUをマネージド環境で利用可能に~

GMOインターネットグループの、GMOインターネット株式会社(代表取締役 社長執行役員:伊藤 正 以下、GMOインターネット)が提供する高性能GPUクラウドサービス「GMO GPUクラウド」(https://gpucloud.gmo/)は、2026年3月25日(水)よりマネージドSlurm環境を提供する専用プランのGPUラインナップに「NVIDIA HGX B300」を追加し、提供を開始いたしました。

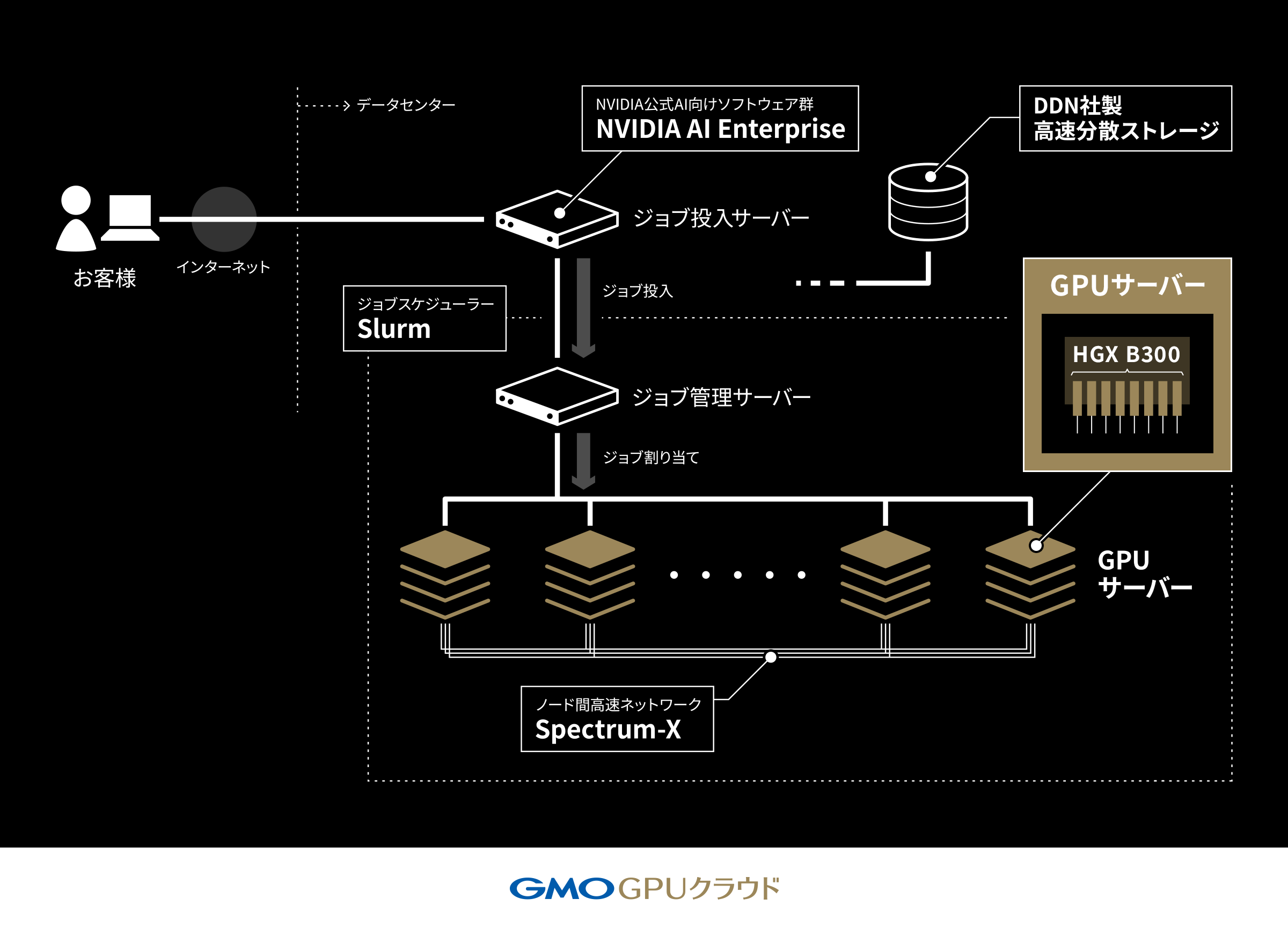

「GMO GPUクラウド」は、高性能な「NVIDIA Blackwell Ultra」、AIワークロード向けイーサネットファブリック「NVIDIA Spectrum-X」(以下、Spectrum-X)採用のNVIDIA推奨構成インフラ上に構築した、最適化済みのマネージドSlurm環境で提供します。

GMOインターネットは、今後もAI開発・研究の現場に最先端のAI計算基盤を提供し、日本の国際競争力強化に貢献してまいります。

サービス提供の背景

独自LLM(大規模言語モデル)の開発やエージェントAIの実装が加速する中、AIインフラの価値基準は変化しています。単に計算資源を確保するだけでなく、その使いやすさと性能を最大限に引き出せるかが重要な観点になっています。

GMOインターネットはこの潮流にいち早く応え、2024年にマネージドHPCクラスタサービスとして構築不要のSlurm環境を、当時最新の「NVIDIA H200 GPU」で提供を開始しました。さらに2025年には推論ニーズの高まりに対応するため、幅広い用途で利用可能なベアメタルサービスを開始しました。推論処理の高速化を実現するFP4への対応など、推論用途でも進化を遂げたHGX B300を国内最速クラス(※1)で提供することで、国内のAI産業の発展を支えてきました。

HGX B300は前世代と比較して、学習用途としても高い性能を持ちます。依然として高い学習ニーズとそれを支えるHPCクラスタへの統合というお客様からのニーズに応えるため、この度、マネージドHPC クラスタサービスの専用プランにHGX B300をラインナップとして追加いたしました。

(※1)GMO GPUクラウド「NVIDIA HGX B300」のクラウドサービスを国内最速クラスで提供開始(2025年12月時点)

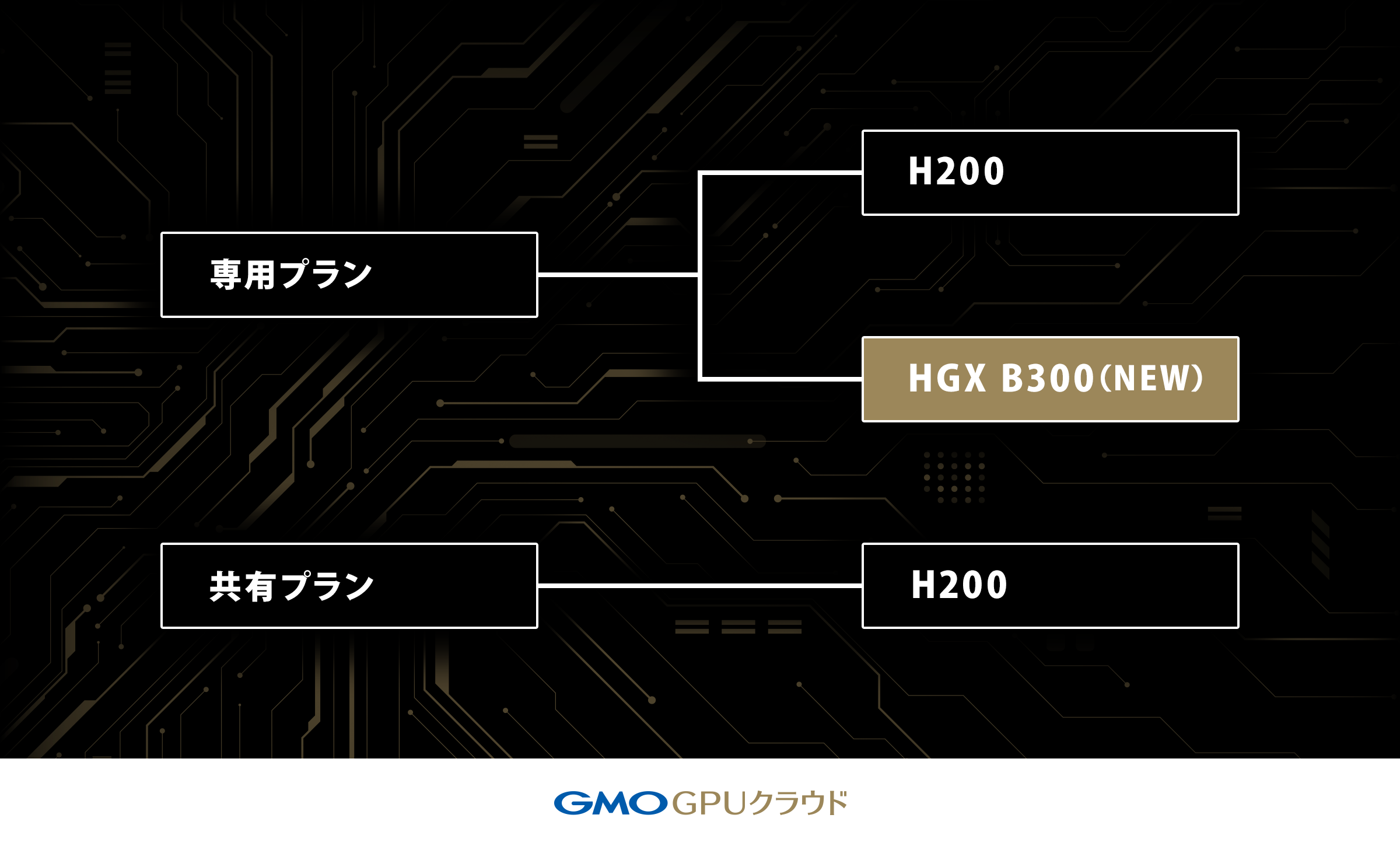

「専用プラン」にHGX B300を新たに追加

専用プランにHGX B300をラインナップとして追加したことにより「最新のHGX B300で学習・開発を行いたいが、インフラ構築にかける時間は削減したい」といったお客さまに対し、必要な環境がすべてセットアップされたAI開発基盤を提供できるようになりました。NVIDIA推奨構成を採用した本サービスは、AI向けイーサネット ネットワーキング プラットフォーム「NVIDIA Spectrum-X」、DDN(DataDirect Networks, Inc.)の高速分散ストレージを採用しています。これにより、面倒な設定やチューニングを行うことなく、サービス利用開始後すぐにHGX B300の性能を最大限に引き出し、ユーザーのワークロードを加速します。

1.「GMO GPUクラウド」専用プランについて

「GMO GPUクラウド」では、利用要件に応じて、GPUサーバーリソースを専有利用できる専用プランを提供しています。複数ユーザーでGPUサーバーを共用するのではなく、契約したリソースを専有できるため、混雑の影響を受けることなく、高い性能が求められる幅広い用途に利用いただけます。

■主な特徴:

・ 構築済みSlurm実行環境(GPUソフトウェアスタックをインストール・最適化済み)

・ NVIDIA推奨構成の採用

・ インターコネクトネットワーク設定済み(ローカルNWも利用可能)

・ 管理ダッシュボードによる可視化・運用支援

・ 高速分散ストレージ

Slurmによる統制されたリソース管理のもと、組織のワークロードの効率を最大化し、AI開発のサイクルを加速させます。

2.専用プランサービス概要

| サービス名 | GMO GPU クラウド |

|---|---|

| 提供開始日 | 2024年11月22日 |

| ユースケース |

・大規模言語モデルの高速学習とファインチューニング ・コンピュータビジョンモデルの大規模データセットを用いた学習など |

| 価格 | 各社ごとにお見積り |

| 利用ユーザー数上限 | 100人 |

| ローカルストレージ | 無料 30 TiB / 台(ジョブ投入時の一時領域として) |

| ホームストレージ領域 | 無料 100GiB / ユーザー |

| 高速共有ストレージ | 3万円 / TiB・月 1TiB〜100TiB |

3.選択可能なGPU

| NVIDIA HGX B300 | NVIDIA HGX H200 | |

|---|---|---|

| GPUメモリ |

計2.3TB (288GB HBM3e ×8) |

計1.1TB (141GB HBM3e ×8) |

| CPU構成 | Intel Xeon 6767P ×2 | Intel Xeon Platinum 8480+ ×2 |

| メインメモリ | 3 TB | 2 TB |

| スクラッチ領域 | 14 TB | 14 TB |

| FP4 Tensorコア | 144PFLOPS / 108PFLOPS | – |

| FP8 Tensorコア | 72PFLOPS / 36PFLOPS | 32PFLOPS / 16PFLOPS |

| FP16 Tensorコア | 36PFLOPS / 18PFLOPS | 16PFLOPS / 8PFLOPS |

| FP32 | 600TFLOPS | 540TFLOPS |

| インターコネクト |

NVIDIA ConnectX-8 SuperNIC ×8 合計 6,400Gbps |

NVIDIA BlueField-3 SuperNIC ×8 合計 3,200Gbps |

| NVLINK (GPU間帯域 / GPU1基ごと) |

第5世代(1,800GB/s) | 第4世代(900GB/s) |

今後の展開

GMOインターネットは、「GMO GPUクラウド」を通じた最先端AIインフラの提供により、急速に進化するAI・ロボティクス分野の技術革新に貢献してまいります。今後も最新のAI計算基盤の迅速な提供と、お客様のニーズに応じた柔軟なクラウド環境の構築により、日本のAI産業に不可欠な国産AIインフラとして、社会と産業のAIイノベーション創出に貢献してまいります。

▼詳しくは下記からお問い合わせください

関連記事

お問い合わせ

お問い合わせフォームにご入力いただき、送信ボタンをクリックしてください。

弊社担当からご入力いただいたメールアドレス宛にご連絡いたします。

一覧に戻る

一覧に戻る